IA

Gemma 4: IA en tu móvil sin internet y gratis

Estás en un AVE cruzando un túnel. Sin cobertura. Sacas el móvil, abres una app y le pides que te resuma un informe de 40 páginas antes de llegar a tu reunión

¿Te imaginas hablar con tu IA en un avión o en una isla desierta sin cobertura, manteniendo toda la información privada en tu móvil? Eso es exactamente lo que puedes conseguir con Gemma 4 de Google, el hermano pequeño de Gemini.

Gemma 4 de Google permite ejecutar inteligencia artificial directamente en tu móvil, sin Wi-Fi, sin datos y sin enviar nada a ningún servidor. Estás en un AVE cruzando un túnel, sin cobertura. Sacas el móvil, abres una app y le pides que te resuma un informe de 40 páginas antes de llegar a tu reunión en Barcelona. La IA lo hace en segundos.

Hace dos años, esto era ciencia ficción. Hoy, con Gemma 4 de Google y apps como Edge Gallery o Locally AI, es algo que puedes hacer ahora mismo con tu teléfono.

Si llevas tiempo siguiendo el mundo de la inteligencia artificial, sabes que la IA en el móvil era hasta ahora una promesa a medias: cuanto más potente el modelo, más dependías de la nube. Modelos como Claude Opus 4.6 o GPT 5.4 necesitan servidores enormes para funcionar. Pero esa ecuación está empezando a romperse.

En este artículo vas a entender qué es Gemma 4, cómo puedes usarlo hoy en tu móvil sin conexión, qué puede hacer (y qué no), cómo la misma tecnología está transformando el edge computing y los dispositivos IoT, y por qué todo esto importa para tu negocio más de lo que crees.

Qué es Gemma 4 y por Qué Debería Importarte

Google Gemma es la familia de modelos de IA abiertos de Google. No es un servicio en la nube. Es un modelo que te descargas, ejecutas en tu hardware y usas como quieras. Gemma 4, la última generación, es el modelo open source más capaz que Google ha publicado hasta la fecha.

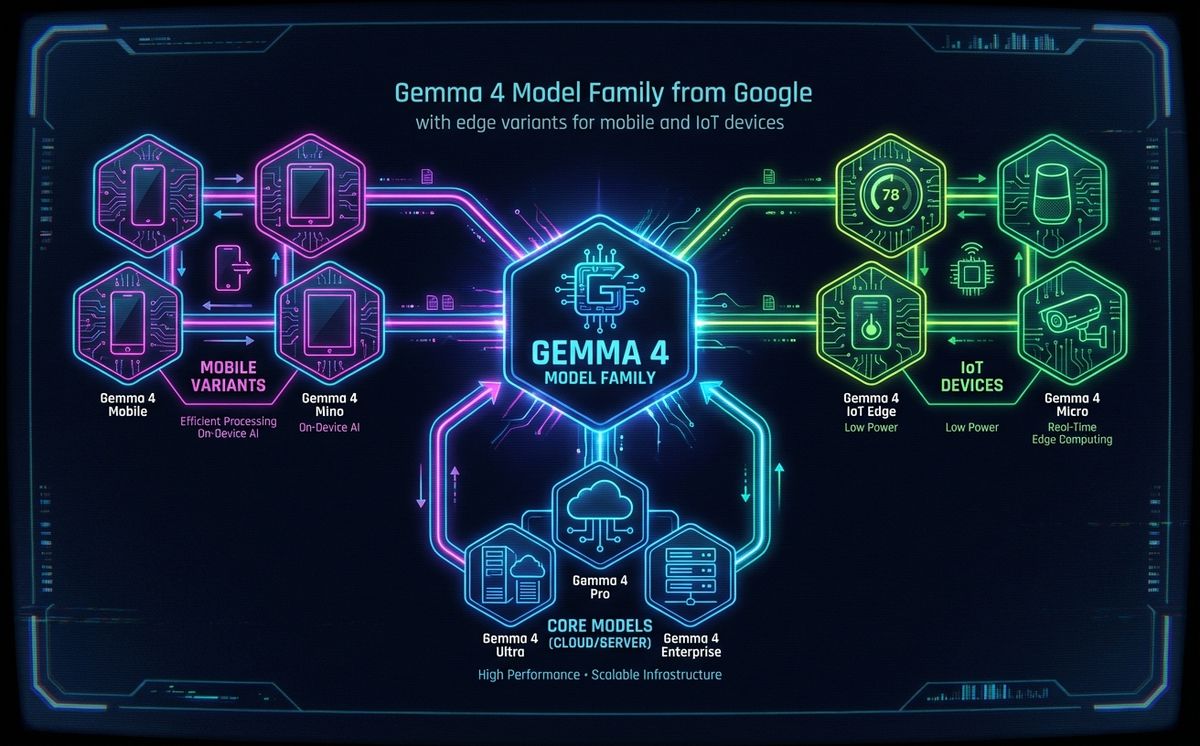

La familia incluye varios tamaños:

- 31B y 26B MoE: Los modelos grandes, pensados para servidores y GPUs potentes

- E4B y E2B: Los modelos edge, diseñados para ejecutarse directamente en tu móvil como un iPhone 16 Pro, un Raspberry Pi o un NVIDIA Jetson

Los modelos edge son los que nos interesan aquí. El E4B y el E2B están optimizados para funcionar con los recursos limitados de un teléfono. Y no estamos hablando de un chatbot básico.

Gemma 4 es multimodal: entiende texto, imágenes y audio. Incorpora un codificador de audio capaz de transcribir voz y traducir en varios idiomas segmentos de hasta 30 segundos. Los modelos edge tienen una ventana de contexto de 128K tokens, que es suficiente para procesar documentos largos sin problema.

Y un detalle importante: está entrenado de forma nativa en más de 140 idiomas, incluido el español de España y sus variaciones regionales. No es una traducción forzada del inglés. Entiende el español de verdad.

Todo bajo licencia Apache 2.0. Eso significa que cualquier empresa, desarrollador o institución puede descargarlo, modificarlo, entrenarlo con sus propios datos y comercializar el resultado. Gratis. Ya disponible en Hugging Face, Kaggle, Ollama y LM Studio.

Ana, directora de una consultora de 12 personas en Madrid, lo probó la semana pasada. Descargó el modelo E4B en su iPhone, le pasó tres propuestas comerciales en PDF y le pidió un resumen comparativo. “Tardó 15 segundos, y lo hizo sin conexión, en el metro”, nos contó. “No es perfecto, pero para un primer filtro rápido es brutal. Y no he enviado los datos de mis clientes a ningún servidor de terceros.”

Si quieres entender cómo se comparan los modelos de IA actuales para trabajo diario, te recomendamos nuestra comparativa de Claude vs ChatGPT, donde analizamos las diferencias prácticas entre los modelos más usados.

Cómo Ejecutar Gemma 4 en tu Móvil Ahora Mismo

¡No necesitas ser desarrollador! Hay dos caminos principales para tener inteligencia artificial sin internet funcionando en tu teléfono hoy.

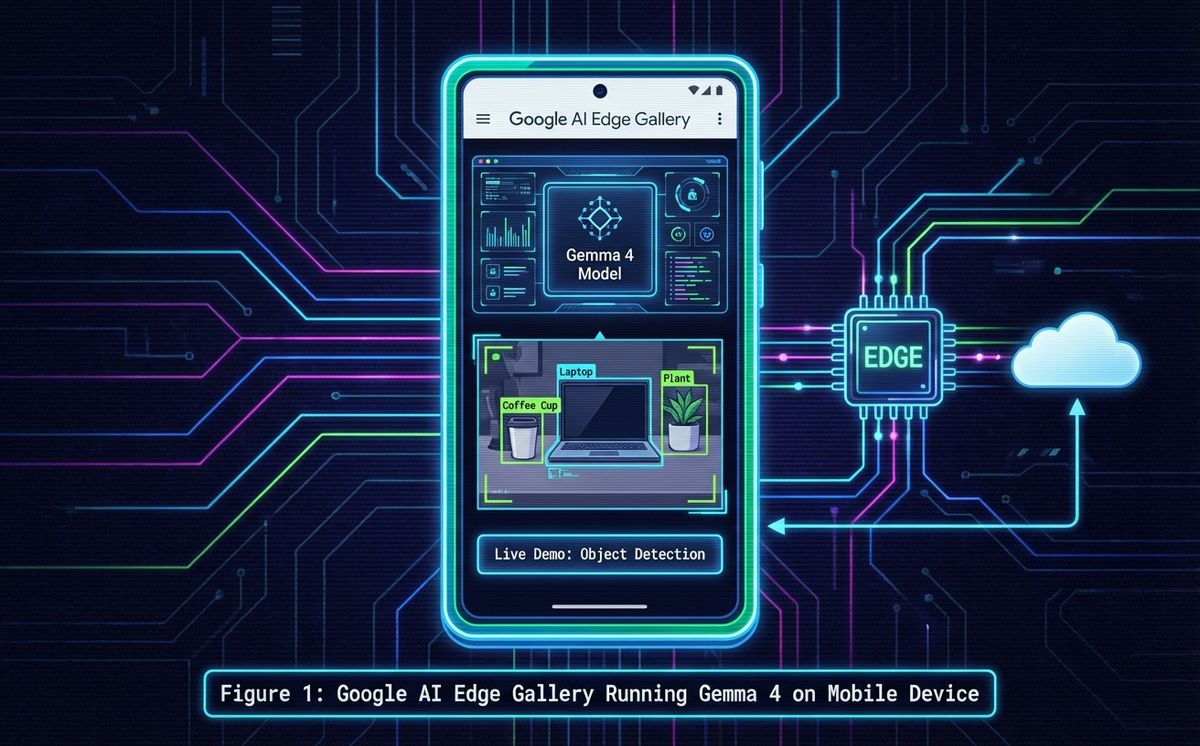

Google AI Edge Gallery

Es la app oficial de Google para ejecutar modelos de IA en el dispositivo. Disponible en iOS y Android. La instalas, seleccionas el modelo Gemma 4 (E2B o E4B según la capacidad de tu teléfono), lo descargas una vez con conexión y a partir de ahí funciona completamente offline.

Dentro de Edge Gallery puedes acceder a las capacidades de Gemma 4 organizadas por función:

- Chat: Conversación general, preguntas, resúmenes, traducciones

- Agent Skills: Flujos de trabajo autónomos de varios pasos, ejecutados directamente en el dispositivo

- Image: Análisis y descripción de imágenes

- Scribe: Transcripción de audio y asistencia de escritura

Las Agent Skills son especialmente interesantes. Es una de las primeras implementaciones de agentes de IA que ejecutan flujos de trabajo autónomos multi-paso completamente en el dispositivo. Sin nube. Sin API. Todo local.

Locally AI y Otras Alternativas

Si prefieres más control, apps como Locally AI, Private LLM (iOS) o MLCChat (Android) te permiten descargar y ejecutar modelos de IA en local con más opciones de configuración. Otra opción interesante es Osaurus para Mac.

Locally AI es especialmente interesante porque no se limita a Gemma. Puedes ejecutar también modelos como Llama 3.2 o Qwen 3.5. Es como tener un Ollama en tu bolsillo.

La experiencia no es perfecta. Los tiempos de respuesta son más lentos que en la nube. Los modelos edge no tienen la profundidad de razonamiento de un modelo de servidor. Pero para tareas como resumir documentos, traducir, responder preguntas sobre un texto o mantener una conversación, funcionan sorprendentemente bien ¿Lo mejor? gratis.

¿Puede una IA de Bolsillo Competir con Claude Opus o GPT 5.4?

La respuesta corta: no (Todavía no).

Seamos honestos. Google Gemma 4 E4B es un modelo de 4.000 millones de parámetros ejecutándose en un chip de móvil. Claude Opus 4.6 o GPT 5.4 son modelos con órdenes de magnitud más parámetros, ejecutándose en clusters de GPUs que consumen más electricidad que un edificio de oficinas.

La diferencia se nota en razonamiento complejo, generación de código largo, análisis multi-paso profundo y creatividad avanzada. Un Opus 4.6 puede mantener una conversación técnica de dos horas con contexto perfecto. Un Gemma 4 en tu móvil se queda corto ahí.

Pero aquí viene la reflexión importante: la trayectoria.

Piensa en dónde estaban los modelos de lenguaje hace dos años. GPT-3.5 era lo mejor que existía y se consideraba revolucionario. Hoy, un modelo open source que cabe en tu teléfono supera en muchas tareas lo que GPT-3.5 hacía en un servidor.

Según Gartner, para 2027 las organizaciones usarán modelos pequeños y especializados tres veces más que modelos grandes de propósito general. La tendencia, confirmada también por el análisis de Edge AI Vision Alliance sobre el estado de los LLMs on-device en 2026, es clara: los small language models están mejorando a un ritmo acelerado.

¿Es descabellado pensar que un hipotético Gemma 6 o Gemma 7, ejecutándose en el hardware móvil de 2028 o 2029, igual a lo que hoy hace un Opus 4.6 en la nube? No lo es. La ley de Moore sigue empujando, los chips móviles son cada vez más potentes, y las técnicas de cuantización y destilación de modelos avanzan cada trimestre. Que no es poca cosa.

Carlos, CTO de una startup de agtech en Valencia, lo resume bien: “Hoy uso Opus para diseñar la arquitectura de nuestros sistemas y Qwen 3.5 en el móvil con Locally AI para consultas rápidas cuando estoy en el campo visitando invernaderos. Son herramientas complementarias. Pero veo la curva. En tres o cuatro años, el modelo del móvil va a cubrir el 80% de lo que hoy necesito del grande.”

El futuro de la IA no es necesariamente más grande. Es más cerca.

Edge Computing e IoT: La Misma Revolución en Dispositivos Industriales

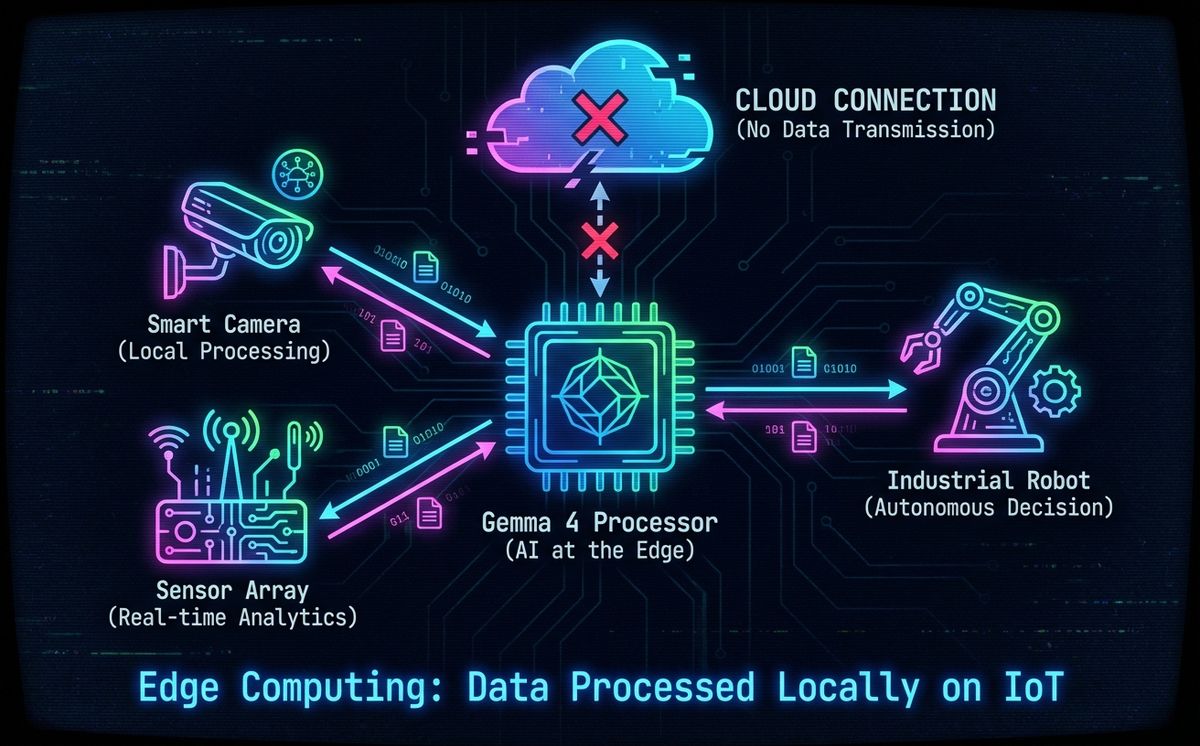

Si la IA funciona offline en tu móvil, piensa qué significa para dispositivos que nunca han tenido buena conexión a internet: sensores en una fábrica, cámaras en una explotación agrícola, dispositivos médicos en una ambulancia.

Qué es el Edge Computing y por Qué Importa

El edge computing, o computación en el borde, consiste en procesar datos directamente en el dispositivo o cerca de él, en lugar de enviarlos a un servidor en la nube. No es un concepto nuevo, pero la combinación con IA lo transforma todo.

Cuatro razones por las que la IA on device importa para IoT:

- Latencia cercana a cero: Un sensor que procesa datos localmente responde en milisegundos. Enviar esos datos a la nube y esperar respuesta puede tardar cientos de milisegundos o segundos. En aplicaciones industriales o médicas, esa diferencia salva equipos y vidas.

- Privacidad total: Los datos nunca salen del dispositivo. Para sectores regulados como salud, finanzas o defensa, esto simplifica enormemente el cumplimiento normativo.

- Funciona sin conectividad: Una fábrica en una zona rural, un invernadero, un barco, una ambulancia. Muchos entornos industriales no tienen conectividad fiable. La IA en el borde funciona igual.

- Coste reducido: Procesar en el dispositivo elimina costes de transferencia de datos y de API cloud. A escala, la diferencia es enorme.

La computación en el borde con IA integrada transforma sectores que antes dependían exclusivamente de la nube.

Gemma 4 en Dispositivos Edge

Google ha demostrado que los modelos Gemma 4 E2B y E4B funcionan como on-device AI en dispositivos como Raspberry Pi y NVIDIA Jetson Orin Nano. Según el blog oficial de Google Developers, estos modelos multimodales ejecutan tareas con latencia cercana a cero en dispositivos edge.

Esto abre casos de uso que antes requerían conexión cloud:

- Agricultura inteligente: Cámaras con IA integrada que detectan plagas o enfermedades en cultivos sin enviar imágenes a ningún servidor

- Manufactura: Sensores que identifican anomalías en tiempo real y ajustan parámetros de producción automáticamente

- Retail: Dispositivos en tienda que analizan patrones de comportamiento sin enviar vídeo a la nube

- Salud: Dispositivos médicos que procesan datos del paciente localmente, cumpliendo normativas de privacidad por diseño

Laura, fundadora de una startup de healthtech en Bilbao, ya lo está implementando: “Nuestro dispositivo de monitorización cardíaca usa un modelo Gemma E2B para analizar los datos del paciente en el propio dispositivo. Los datos sensibles nunca salen del aparato. Eso nos ha reducido seis meses el proceso de certificación médica porque el framework de privacidad es mucho más simple.” Realmente es en casos como estos donde una IA offline brilla.

El ecosistema técnico que lo hace posible incluye herramientas como ExecuTorch (deploy móvil con solo 50KB de footprint), llama.cpp para inferencia en CPU, y MLX para Apple Silicon. Todo open source. Todo gratuito.

Si te interesa el mundo de las herramientas de IA open source, echa un vistazo a nuestro artículo sobre herramientas de IA open-source como OpenClaw para entender hacia dónde se mueve el ecosistema.

¿Qué Significa Todo Esto para tu Negocio?

Vale, la tecnología es fascinante. Pero si diriges una pyme o estás construyendo un producto, la pregunta real es: ¿cómo me afecta esto?

Si tienes una app o un producto digital: La IA en el móvil y la inteligencia artificial local te permiten integrar IA directamente en tu aplicación sin depender de APIs de terceros. Sin costes por llamada. Sin latencia de red. Sin enviar datos de tus usuarios a servidores externos. Para funcionalidades como búsqueda inteligente, resúmenes, asistentes contextuales o traducción, un modelo como Gemma 4 E4B es más que suficiente.

Si trabajas con IoT o hardware: Puedes añadir inteligencia a tus dispositivos sin necesidad de conectividad permanente ni infraestructura cloud. Un sensor, una cámara o un dispositivo embebido con un modelo Gemma E2B puede tomar decisiones inteligentes de forma autónoma.

Si manejas datos sensibles: Procesamiento 100% local significa compliance simplificado. RGPD, HIPAA, normativas sectoriales. Si los datos nunca salen del dispositivo, una capa entera de complejidad regulatoria desaparece.

Si quieres reducir costes de IA: Cada llamada a una API de un modelo grande cuesta dinero. A escala, esos céntimos se convierten en miles de euros al mes. Ejecutar un modelo local en el dispositivo del usuario tiene coste cero de inferencia.

Si necesitas IA disponible siempre: En sectores como logística, transporte o emergencias, no puedes depender de que haya cobertura para usar IA. Un modelo como Gemma 4 funcionando en el borde garantiza que la inteligencia artificial está disponible en cualquier situación, sin excepciones.

El futuro no es “cloud o local”. Es híbrido: modelos grandes en la nube para tareas complejas que requieren máxima capacidad, y modelos como Gemma 4 en el dispositivo para todo lo demás. La clave está en saber cuándo usar cada uno.

Si quieres explorar cómo integrar IA local o edge computing en tu producto, consultoría de IA para empresas es exactamente lo que hacemos en LetBrand. Auditamos tus flujos de trabajo, identificamos dónde la IA aporta valor real y te ayudamos a implementarlo sin humo ni promesas vacías.

Gemma 4 y el Futuro de la IA Local: Más Cerca de lo que Piensas

Recapitulemos lo esencial:

- Google Gemma 4 es un modelo de IA open source que funciona en tu móvil sin internet, con capacidades multimodales (texto, imagen, audio) y Agent Skills autónomos

- Apps como Edge Gallery y Locally AI te permiten probarlo hoy mismo en iOS o Android, sin ser un experto

- La misma tecnología aplicada a edge computing e IoT permite que sensores, cámaras y dispositivos industriales procesen datos con IA sin depender de la nube

- Hoy, los small language models como Gemma 4 no compiten con los grandes. Pero la brecha se cierra cada año y Gartner ya predice que estos modelos pequeños dominarán para 2027

- Para tu negocio, esto significa IA más barata, más privada y disponible en cualquier lugar

La IA está saliendo de los centros de datos y llegando a tu bolsillo. No como un producto de lujo ni como una demo. Como una herramienta real que funciona sin Wi-Fi, sin API y sin enviar tus datos a nadie.

Lo que estamos viendo con Gemma 4 no es solo un modelo más. Es el comienzo de un cambio de paradigma en cómo se distribuye y consume la inteligencia artificial. Cuando puedes ejecutar un modelo multimodal, con capacidades de agente autónomo, completamente offline en un dispositivo que cabe en tu bolsillo, las reglas del juego cambian para desarrolladores, empresas y usuarios por igual.

La privacidad deja de ser una promesa de marketing. La latencia deja de ser un problema. Y el coste de usar IA baja a cero por inferencia. No es ciencia ficción. Es tecnología que puedes descargar hoy.

La pregunta ya no es si la IA llegará a los dispositivos. Ya llegó. La pregunta es cuándo la vas a usar.

¿Tienes un proyecto donde Gemma 4, la IA local o el edge computing podrían marcar la diferencia? Cuéntanos tu proyecto. 30 minutos, sin pitch, sin compromiso. Solo hablamos de lo que tiene sentido para tu caso.

Artículos Relacionados

Si has pasado algo de tiempo en Twitter, Hacker News o Reddit en los últimos dos meses, probablemente has visto el emoji de langosta. ¿Qué es OpenClaw? Es el ag

Leer más

¿Qué pasaría si su próximo proyecto de software pudiera pensar, planificar y adaptarse de forma autónoma? El auge de los agentes de IA autónomos representa uno

Leer másListo para empezar tu proyecto?

Hablemos de cómo podemos ayudar a tu marca a crecer con una estrategia digital personalizada.

Contáctanos